“Cha đỡ đầu” của AI rời Google để cảnh báo về sự nguy hiểm của công nghệ này

- VOA

- •

Một nhà khoa học máy tính thường được gọi là “cha đỡ đầu của trí tuệ nhân tạo” (AI) đã nghỉ việc tại Google và lên tiếng về sự nguy hiểm của công nghệ này.

Ông Geoffrey Hinton, người tạo ra công nghệ cơ bản cho các hệ thống trí tuệ nhân tạo, nói với The New York Times rằng tiến bộ trong lĩnh vực này đặt ra “những rủi ro sâu sắc cho xã hội và nhân loại”.

“Hãy nhìn xem tình hình 5 năm trước và tình hình hiện tại”, phát biểu của ông được trích dẫn trong bài báo xuất bản hôm thứ Hai.

“Nếu tiếp tục lan truyền những khác biệt đó về phía trước thì thật đáng sợ.”

Ông Geoffrey Hinton cho biết, sự cạnh tranh giữa những ‘gã khổng lồ’ công nghệ đang thúc đẩy các công ty tung ra các công nghệ trí tuệ nhân tạo mới với tốc độ nguy hiểm, gây nguy cơ mất việc làm và lan truyền thông tin sai lệch.

“Thật khó để thấy làm thế nào bạn có thể ngăn chặn những kẻ xấu sử dụng nó cho những điều xấu”, ông nói với tờ New York Times.

Vào năm 2022, Google và OpenAI — công ty khởi nghiệp đằng sau chatbot AI phổ biến ChatGPT — bắt đầu xây dựng các hệ thống sử dụng lượng dữ liệu lớn hơn bao giờ hết.

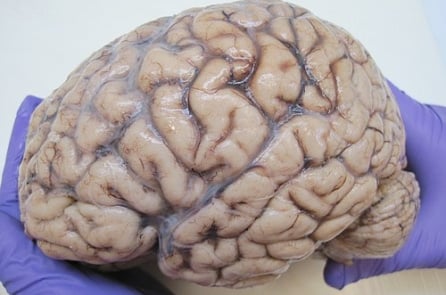

Ông Hinton nói với tờ New York Times rằng ông cho rằng ở một số phương diện nào đó, các hệ thống này đang làm lu mờ trí thông minh của con người, bởi vì chúng có khả năng phân tích lượng dữ liệu khổng lồ.

Ông nói, “Có lẽ những gì đang diễn ra trong các hệ thống này thực sự tốt hơn nhiều so với những gì đang diễn ra trong não bộ.”

Mặc dù AI đã được sử dụng để hỗ trợ các công việc của con người, nhưng việc mở rộng nhanh chóng các chatbot như ChatGPT có thể khiến công việc gặp rủi ro.

Ông nói với New York Times rằng AI “lấy đi sự cực nhọc”, nhưng “nó có thể lấy đi không chỉ những thứ này”.

Nhà khoa học này cũng cảnh báo rằng thông tin sai lệch do trí tuệ nhân tạo tạo ra có thể bị lan truyền, ông nói với tờ New York Times rằng những người bình thường sẽ “không thể biết đâu là sự thật” nữa.

Theo New York Times, ông Hinton đã thông báo cho Google về quyết định từ chức vào tháng trước.

Nhà khoa học trưởng về trí tuệ nhân tạo của Google, ông Jeff Dean, đã cảm ơn ông Hinton trong một tuyên bố với giới truyền thông Hoa Kỳ.

“Là một trong những công ty đầu tiên công bố các nguyên tắc AI, chúng tôi vẫn cam kết thực hiện một cách tiếp cận có trách nhiệm với AI”, tuyên bố cho biết thêm.

“Chúng tôi không ngừng học hỏi, tìm hiểu những rủi ro mới xuất hiện và đồng thời cũng mạnh dạn đổi mới.”

Vào tháng 3, tỷ phú công nghệ Elon Musk và một loạt chuyên gia đã kêu gọi tạm dừng phát triển hệ thống trí tuệ nhân tạo để có thời gian đảm bảo sự an toàn từ chúng.

Một bức thư ngỏ có chữ ký của hơn 1.000 người, bao gồm cả ông Musk và đồng sáng lập Apple Steve Wozniak. Việc phát hành GPT-4 là nhân tố dẫn đến bức thư ngỏ này, trong khi đó GPT-4 là một phiên bản mạnh mẽ hơn của công nghệ mà ChatGPT sử dụng.

Ông Hinton đã không ký vào bức thư vào thời điểm đó, nhưng nói với New York Times rằng các nhà khoa học không nên “mở rộng quy mô của nó hơn nữa cho đến khi hiểu biết rằng liệu họ có thể kiểm soát nó hay không”.

Từ khóa AI ChatGPT Geoffrey Hinton google trí tuệ nhân tạo Trí thông minh nhân tạo